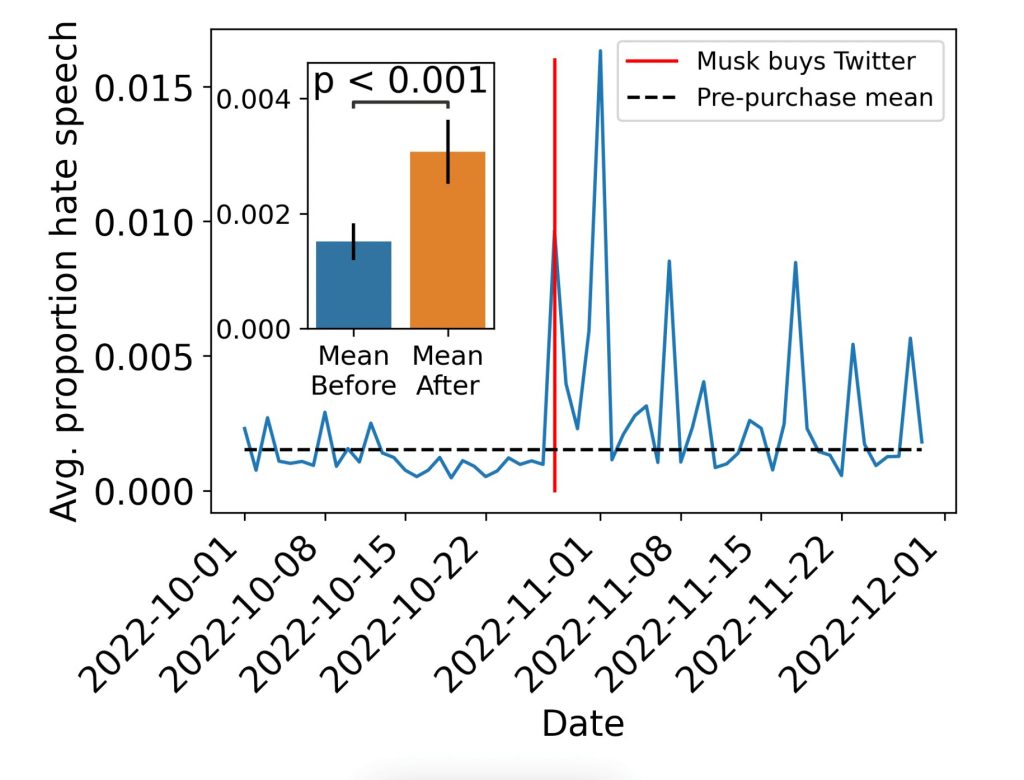

Une récente étude faite par des chercheurs à l’université de Californie du Sud a révélé que les discours haineux sur Twitter, renommé X, ont doublé depuis son acquisition par Elon Musk, passant de 0,2 % à 0,5 % des publications sur le réseau social. Les différences de modération entre les différents réseaux sociaux peuvent s’expliquer par deux raisons : d’une part, des politiques d’utilisation différentes ; d’autre part, des disparités dans les détections et répressions des contenus violant ces politiques

Tout d’abord les publications faites sur un réseau social sont des variables à prendre en compte lors d’une campagne marketing numérique. Les postes publiés pour la campagne seront associés à la plateforme et aux autres contenus qui y sont publiés. Par exemple, un discours haineux publié juste à coté d’une publication promotionnelle impactera impactera l’entreprise C’est pour cette raison qu’une vérification doit être faite pour déterminer si le réseau correspond aux valeurs de l’entreprise.

Le libertarianisme au coeur de Twitter

Premièrement, le nouvel acquéreur revendique son appartenance au mouvement libertarien. Cette idéologie priorise les libertés individuelles, au détriment de la morale et bon fonctionnement de la société. Il a dès lors modifié les règles relatives au contenu autorisé pour qu’elle soit en accord avec son idéologie. Il a assoupli celles concernant les discours haineux et la désinformation et a même autorisé le contenu pour adulte.

L’inefficacité de l’algorithme de Twitter

Deuxièmement, pour tous les réseaux sociaux, les détections et les suppressions des contenus inadaptés se basent sur un mélange entre une décision informatisée et une décision humaine. La méthode utilisée consiste à faire analyser par un algorithme tous les cas problématiques. Par la suite, l’algorithme supprime le contenu ne respectant pas les règles et le transmet à des modérateurs humains, les publications se trouvant dans une zone grise qui décide de la conformité ou non et des éventuelles sanctions.

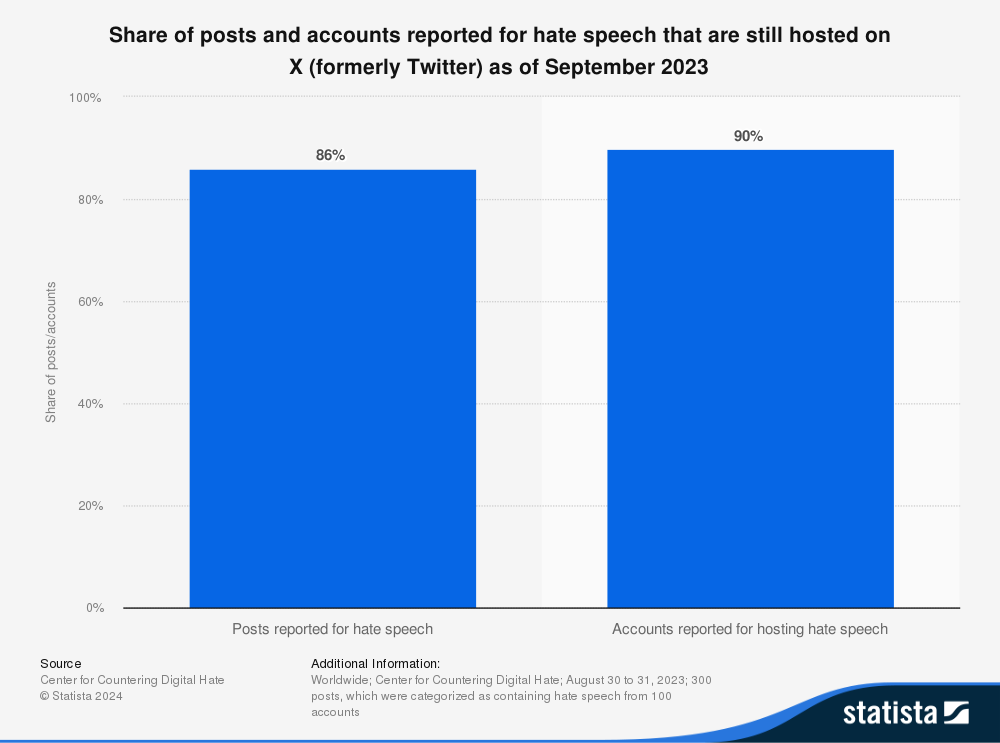

Selon un rapport fait par le CCDH (Center for Countering Digital Hate), le principal problème avec Twitter est que 90 % des discours haineux, manifestement contraires à la politique d’utilisation, restent sur la plateforme. Ils ont aussi relevé que 86 % de ses auteurs ne font pas l’objet d’un bannissement. L’une des explications de ces résultats médiocres est la réduction de 15 % des effectifs de modération et la baisse de leur budget, alors que les concurrents continuent d’investir dans ce secteur pour améliorer l’expérience utilisateur.

Pour conclure, il est légitime de se demander si l’idéologie du propriétaire est la seule raison de ce laxisme , ou s’il l’utilise comme un prétexte pour réduire les coûts et minimiser les pertes engendrées par ce qui est considéré comme l’un des pires investissements récents actuels

Sources :

- Center for Countering Digital Hate. (2023, September 13). X Content Moderation Failure https://counterhate.com/research/twitter-x-continues-to-host-posts-reported-for-extreme-hate-speech/

- Darbinyan, R. (2024, August 12). The growing role of AI in content moderation. Forbes. https://www.forbes.com/councils/forbestechcouncil/2022/06/14/the-growing-role-of-ai-in-content-moderation/

- Hickey, D., Schmitz, M., Fessler, D., Smaldino, P. E., Muric, G., & Burghardt, K. (2023). Auditing Elon Musk’s Impact on Hate Speech and Bots. Proceedings of the International AAAI Conference on Web and Social Media, 17(1), 1133-1137. https://doi.org/10.1609/icwsm.v17i1.22222

- Lemieux, P. (2024, July 31). Elon Musk, Edward Luce, and Libertarianism – Econlib. Econlib. https://www.econlib.org/elon-musk-edward-luce-and-libertarianism/

- Reuters. (2023, January 7). Twitter further cuts staff overseeing global content moderation, Bloomberg reports. Reuters. https://www.reuters.com/technology/twitter-further-cuts-staff-overseeing-global-content-moderation-bloomberg-news-2023-01-07/