Que ce soit en B2C comme en B2B, l’objectif est d’inciter les prospects à réaliser des actions spécifiques. Une conversion peut être un achat, un abonnement à une infolettre ou encore le téléchargement d’une application. Le « conversion rate optimization » (CRO) regroupe l’ensemble des méthodes visant à améliorer le taux de conversion d’un site, d’un parcours client ou d’une campagne. L’A/B testing repose sur des tests comparatifs entre deux versions d’un élément : un wording, un formulaire, un CTA. On détermine ainsi la version qui fonctionne le mieux, améliorant ce qui existe déjà, souvent de manière incrémentale. L’analyse de données est à présent au cœur de la stratégie et de la prise de décision (data-driven) et la culture A/B testing semble s’être démocratisée.

Mais concrètement, quand faut-il faire un test A/B et pourquoi ?

Quand la data devient un levier stratégique: la rigueur scientifique au service de la performance

Les organisations sont de piètres évaluateurs de leurs propres idées, comme l’expliquent Kohavi et Longbotham dans Online Controlled Experiments. La donnée permet alors de transformer l’intuition en certitude et représente en cela une nécessité stratégique. Dans un environnement numérique complexe, on distingue corrélation et causalité pour un arbitrage décisionnel. Sans s’appuyer sur les données, le risque de reproduire des comportements préexistants ou d’investir sans réelle valeur ajoutée s’accentue.

L’optimisation de l’expérience utilisateur (UX)

L’expérimentation contrôlée via A/B tests en ligne constitue selon Kohavi et al. une méthode rigoureuse et scientifique : on isole une variable pour ensuite prouver la causalité directe d’une action marketing. Aussi l’UX est source de gain comme de perte de conversion : 93% des consommateurs sont influencés par le design dans leur achat e-commerce et 1 seule seconde de délai de chargement peut réduire les conversions de 7%. Dans ce contexte, se montrer data-driven réduit grandement les frictions aux moments de vérité (MOT/ZMOT). Les tests d’utilisabilité (données qualitatives) et les évaluations heuristiques (principes d’ergonomie et d’usabilité établis) sont des approches complémentaires à l’A/B testing. Il existe aussi des solutions telles que Hotjar et CubeGO afin d’obtenir des données comportementales. Stefan Thomke (2020), dans son ouvrage Experimentation Works, démontre que les entreprises qui ne testent pas leurs produits ou leurs modèles d’affaires « volent à l’aveugle ».

La culture de l’expérimentation

Chez Booking.com, plus de 1000 tests A/B sont menés simultanément, ce n’est pas une simple expérimentation mais bel et bien une pratique maîtrisée devenue culturelle. D’un point de vue organisationnel, même le CEO doit soumettre ses idées à des tests, aucune exception, c’est la suppression des HIPPOs (Highest Paid Person’s Opinion). Le data washing est ainsi évité, tout comme le biais de confirmation, on ne cherche pas à utiliser la donnée pour légitimer des choix conservateurs ou préexistants. L’expérimentation aide à prendre de meilleures décisions sur la base des données. Les tests réussis sont ceux répondant à une vision stratégique cohérente (Mobile First ici), d’où la nécessité de contextualiser les résultats. Chaque organisation est à un stade différent dans son parcours analytique. D’ailleurs, certains secteurs (E-commerce, SaaS…) sont davantage enclins au CRO que d’autres (Luxe, Culture, ONG…).

Quand la logique data-driven trouve ses limites: le piège de l’exploitation excessive

Faire de l’A/B testing seulement car tout le monde en fait, en fonction des mêmes biais cognitifs (comme la rareté ou la preuve sociale de Cialdini) et des mêmes outils, c’est une bonne pratique limitée dans l’absolu : on risque de standardiser les parcours client et interfaces. Une étude de Convert.com (2021) estime qu’à peine 1 test sur 7 aboutit à un résultat réellement exploitable et/ou actionnable. Tester des micro-changements de façon aléatoire n’a rien d’innovant, c’est l’illusion de progrès.

Qu’est ce qui fait une différence ? Booking.com le montre, ce sont les hypothèses, tangibles et ambitieuses, définies puis testées qui offrent un potentiel innovant.

Mais le recours exclusif aux données finit par freiner l’avantage concurrentiel à long terme.

L’A/B testing : un outil d’exploitation

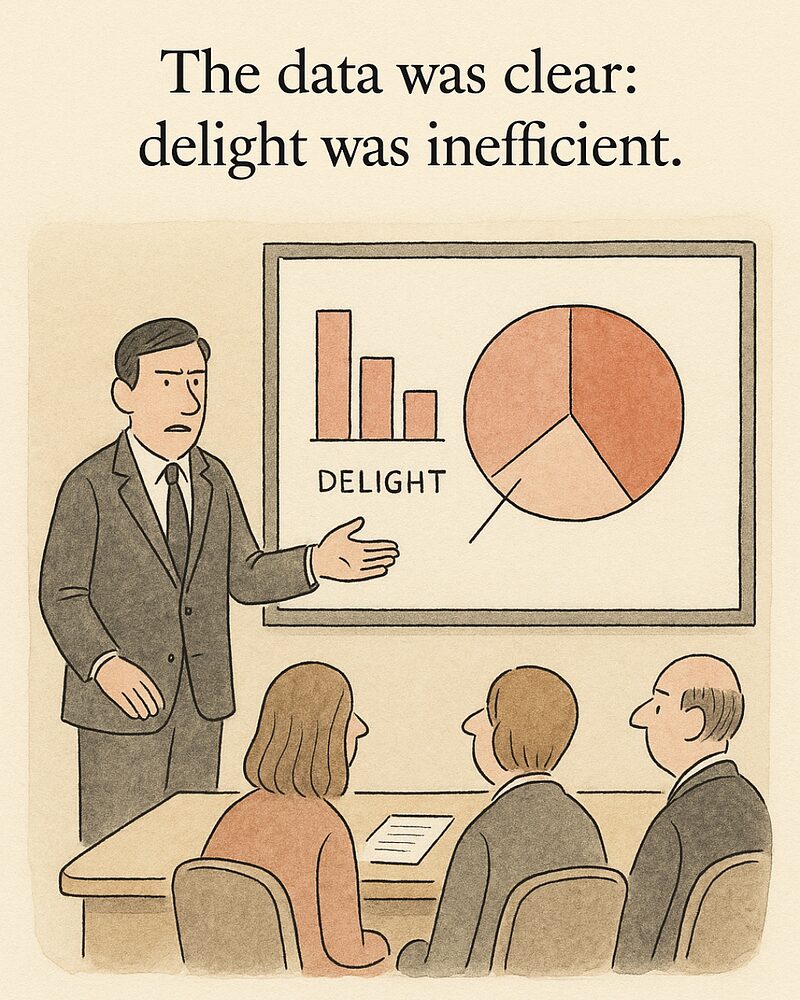

On le comprend à travers James March et sa distinction entre exploration et exploitation. En effet, l’exploitation implique l’efficacité et l’exécution des certitudes actuelles. L’A/B testing y répond : on ajuste un CTA afin pour obtenir des points de conversion sur un modèle existant. L’exploration, quant à elle, suppose la recherche, la prise de risque et la découverte de nouvelles possibilités. Lorsque les entreprises se concentrent uniquement sur les données de performance, elles finissent par étouffer l’innovation exploratoire selon Benner et Tushman (2003), c’est l’exploitation excessive.

L’A/B testing serait avant tout un outil d’exploitation, optimisant le passé sans créer le futur. Les micro-conversions (add-to-cart…) alimentent l’optimisation, ce sont des signaux d’intérêt, des indicateurs de freins, d’engagement… Mais si une variation de page d’accueil génère plus de trafic vers une landing page mais que ce trafic génère par la suite moins de conversions… Les micro-conversions ont alors augmenté tandis que les macro-conversions ont diminué.

Le court-termisme des KPIs

La course à la performance conduit les entreprises à agir sur le court terme (Quick Wins) au détriment d’une vision stratégique, se concentrant sur des KPIs, parfois mal choisis, et limitant la prise de risque, pourtant différenciante. Dans The Innovator’s Dilemma, Christensen (1997) évoque les entreprises qui échouent souvent en écoutant trop leurs données actuelles. Les décideurs hésitent à miser sur des initiatives de rupture et privilégient la garantie d’une amélioration incrémentale mesurable à l’incertitude d’une innovation radicale. Or, il faut considérer à la fois le court et le long terme. Il s’agit de développer une compréhension plus profonde des besoins et des motivations utilisateur. Des tests plus radicaux vont explorer de nouvelles pistes et idées. Autrement dit, le débat ne porte pas sur l’outil en lui-même mais bien sur son usage (Experimentation Works, Stefan Thomke).

Vers le numérique responsable et la maturité managériale

Optimiser pour convertir, est-ce toujours responsable ? Le CRO repose sur l’« architecture du choix » évoqué par Thaler et Sunstein (2008). L’entreprise met en place des micro-ajustements (nudges) et devient ainsi l’architecte du comportement utilisateur. Ces techniques peuvent devenir intrusives selon Flückiger (2018) car elles ciblent une partie inconsciente voire émotionnelle provoquant chez l’utilisateur des réflexes automatiques. L’agilité et la dignité du consommateur sont alors mis en péril lorsqu’au lieu de simplement éclairer, l’optimisation menace le libre arbitre. D’ailleurs, les « dark patterns », ces éléments de conception volontairement manipulatoires vont encore plus loin. Il s’agit d’après Gray et al. (2018) de concevoir les interfaces pour tromper l’utilisateur, privilégiant la valeur actionnariale à la valeur réelle pour l’usager. L’A/B testing est ainsi détourné pour alimenter des techniques manipulatrices.

Cela peut être la sollicitation cognitive, c’est-à-dire utiliser les biais de rareté ou d’urgence pour inciter à la décision rapide. L’addictivité algorithmique, maximisant le temps passé au risque d’engendrer une dépendance, en fait également partie. Chercher à contourner la notion de consentement essentielle à la Loi 25 dans la gestion des cookies pour minimiser les refus est assez courant. Par ailleurs, un site très optimisé n’a pas forcément de portée sociétale, il peut tout aussi bien vendre des produits inutiles qu’encourager des pratiques néfastes pour l’environnement (inciter à la livraison rapide…). De fait, l’optimisation (le « comment ») doit sans doute être encadrée par une gouvernance intelligente.

Un modèle hybride

Dans ce contexte, l’enjeu n’est pas de choisir entre data et intuition mais bien celui de maîtriser ce que Benner et Tushman (2003) appellent l’organisation ambidextre. C’est la capacité d’exploiter la donnée tout en suivant l’intuition (le « quand ») stratégique. En effet, l’expérimentation ne doit pas remplacer la stratégie mais plutôt la servir. « Dire non » à une optimisation court-terme non alignée avec la stratégie permet d’atteindre la maturité managériale. N’ayez pas peur d’explorer vos données ! L’objectif de performance doit s’accompagner d’un désir de pertinence si l’on souhaite agir de façon responsable et construire une relation de confiance durable avec ses clients sur le long terme.

Sources:

- Schulz, S. (2025, 11 septembre). Varify. Comprendre et appliquer l’A/B testing.

- Kameleoon. (2025, 14 octobre). A/B testing: 7 erreurs fréquentes.

- March, J. G. (1991). Exploration and exploitation in organizational learning. Organization Science. https://doi.org/10.1287/orsc.2.1.71.

- HEC Montréal. (2025). Plans de cours et diaporamas – MARK40170 (Séances 1–7).

- Thomke, S. (2020). Experimentation works: The surprising power of business experiments. Harvard Business Review Press.

- Kohavi, R., Tang, D., & Xu, Y. (2017). Online controlled experiments and A/B testing. In Encyclopedia of machine learning and data mining. Springer. https://doi.org/10.1007/978-1-4899-7687-1_891

- Benner, M. J., & Tushman, M. L. (2003). Exploitation, exploration, and process management: The productivity dilemma revisited. https://doi.org/10.5465/amr.2003.9416096