À l’ère du Big Data, les algorithmes publicitaires visent à optimiser la diffusion des annonces, mais cette efficacité masque fréquemment des biais. Dans le domaine du marketing numérique, ces systèmes sont désormais indispensables pour gérer l’augmentation du volume des données et optimiser le ciblage publicitaire. Bien que les processus de publicité algorithmique soient perçus comme neutres en raison de l’absence de subjectivité humaine, ils peuvent en réalité constituer une source de discrimination dans la sphère numérique.

De l’héritage de données biaisées à la logique des enchères publicitaires, tout en passant par l’usage des proxys et le « tri panoptique », cet article explore différents mécanismes à l’origine de ces biais dans la publicité ciblée, ainsi que leur rôle dans la reproduction des inégalités systémiques dans l’espace digital.

Comment les données passées automatisent les biais algorithmiques dans la publicité

Comment l’héritage historique alimente les biais

La reproduction de tendances historiques est le premier élément qui alimente les biais algorithmiques. Lorsqu’on entraine un algorithme de publicité automatisée à partir de données de campagnes antérieures, celui-ci privilégie des audiences similaires aux segments qui ont déjà abouti à de fortes performances. Ce mécanisme, reposant sur l’analyse prédictive, peut alors conduire à une surreprésentation systématique de certains genres ou groupes socioéconomiques dans le ciblage d’audience, au détriment des autres (Shaheen, 2025).

Discrimination numérique et reproduction des inégalités

Outre les biais liés à la performance passée de certaines audiences, la discrimination numérique dans les publicités propulsées par les algorithmes automatisés peut aussi provenir de données historiques qui reflètent des tendances genrées et racialisées. Puisque ces données proviennent de contextes historiques marqués par des inégalités systémiques, les systèmes de publicité algorithmique qui en dépendent risquent d’intégrer ces disparités dans leurs mécanismes d’optimisation et de reproduire des hiérarchies sociales et raciales existantes. En anticipant le comportement futur des utilisateurs à partir de données issues de passés discriminatoires, ces systèmes contribuent en effet à perpétuer des biais historiques au sein des infrastructures numériques (Bui, MclIwain, Olojo, Chang, 2026).

Un exemple d’impact concret sur la visibilité en ligne

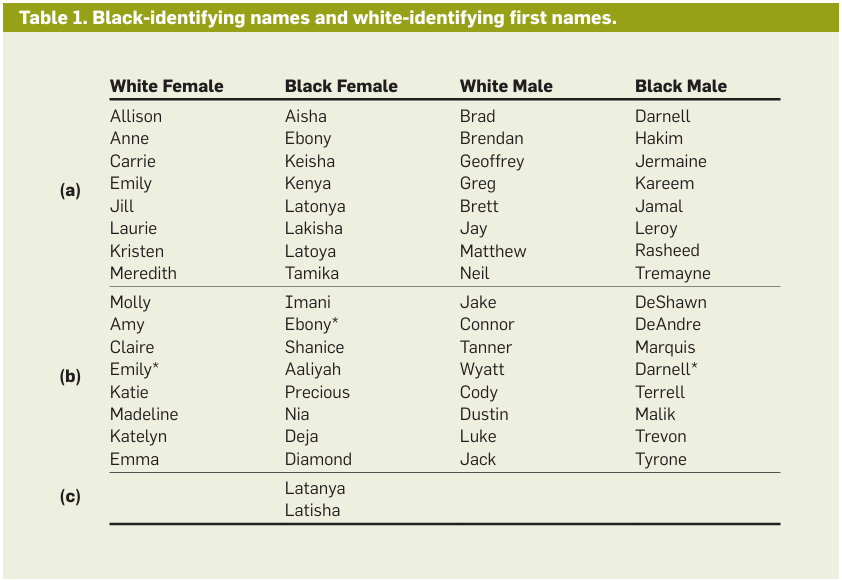

Une étude de Latanya Sweeney (2013) à l’Université de Harvard illustre parfaitement ce phénomène. Dans son article intitulé Discrimination in Online Ad Delivery, elle a démontré que les recherches Google portant sur des prénoms typiquement associés à la communauté afro-américaine, comme « Jamal », généraient beaucoup plus de publicités suggérant des antécédents judiciaires que les recherches sur des prénoms associés aux Blancs, comme « Geoffrey », même sans dossier criminel réel. Le processus algorithmique des publicités Google reproduit alors les préjugés raciaux historiques en renforçant les écarts de traitement en ligne (Sweeney, 2013).

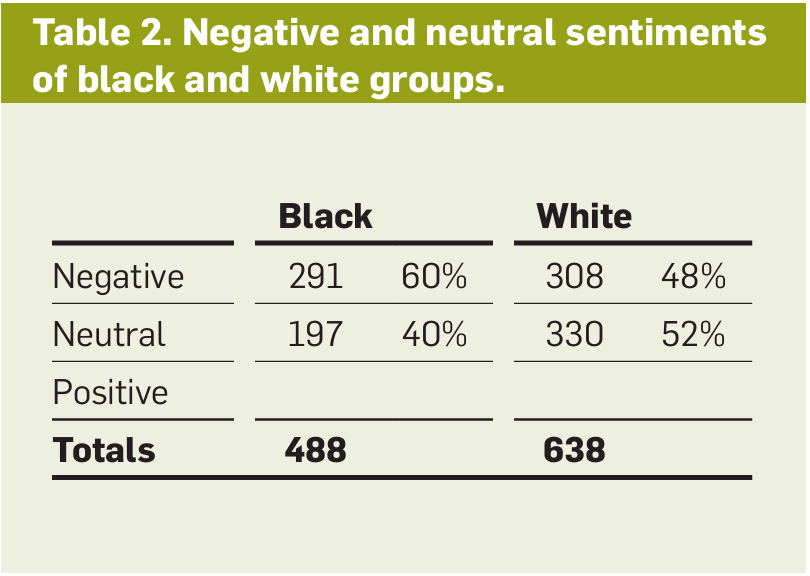

Le tableau ci-dessous, issu de l’article de recherche de Sweeney, exprime la proportion de publicités présentant un sentiment négatif, neutre ou positif, en fonction de la race (Black ou White). Ces résultats démontrent que 60% des 488 publicités en ligne qui sont apparues pour le groupe Noir, c’est-à-dire à la suite de la recherche d’un prénom associé à la communauté afro-américaine, avaient une connotation négative. Pour le groupe Blanc, on passe à 48% de publicités à connotation négative pour 638 publicités affichées.

L’étude a montré que cette différence était statistiquement significative, relevant alors que la recherche sur Google de prénoms associés à la communauté noire, ou afro-américaine, aboutissait à l’affichage d’une plus grosse proportion d’annonces renvoyant un sentiment négatif que la recherche de prénoms associés aux communautés blanches.

Les proxys : un mécanisme de discrimination numérique par substitution

Dans le cadre de la publicité algorithmique et du ciblage de précision en ligne, les proxys, ou variables de substitution, jouent aussi un rôle important. L’analyse algorithmique traite ces données pour déduire des caractéristiques sensibles des utilisateurs, comme la race, le genre ou l’âge, même si on supprime ces catégories explicites (Bui, MclIwain, Olojo, Chang, 2026).

Même sans accès direct à des informations sur la race ou le genre, les algorithmes publicitaires utilisent ainsi la localisation géographique ou des catégories d’affinité (« affinity categories ») comme substituts pour segmenter les populations. Une étude a démontré que même après avoir retiré les données sur la race et d’autres catégories protégées, Facebook a développé des catégories d’affinité auxquelles les usagers étaient associés en fonction de leurs intérêts et de leur comportement de navigation (Bui, MclIwain, Loo, Chang, 2026). En analysant d’énormes volumes de données, les algorithmes identifient des comportements qui ressemblent statistiquement à ceux d’un groupe particulier, en se basant sur des données observées auparavant (Bui, MclIwain, Loo, Chang, 2026).

L’étude citée explique que ce processus permet parfois d’entretenir une segmentation de l’audience basée sur des suppositions raciales peu fondées. Par exemple, les plateformes de ciblage publicitaire utilisent souvent les codes postaux comme proxys pour la race. Effectivement, en raison de la ségrégation résidentielle historique, le lieu d’habitation devient pour l’algorithme un indicateur de l’origine ethnique (Bui, MclIwain, Loo, Chang, 2026).

Ces mécanismes publicitaires s’appuient donc encore sur des algorithmes conçus pour trouver des modèles basés sur des tendances passées ou sur des stéréotypes, ce qui renforce les biais existants et la discrimination numérique.

Le tri panoptique : un dispositif de discrimination au service du profit

Le tri panoptique au service de la publicité

Certaines études portent également à croire que la publicité automatisée en ligne fonctionne parfois comme un système de surveillance constante qui tri, classe, et pénalise les communautés marginalisées, dans le but de maximiser le profit (Bui, MclIwain, Olojo, Chang, 2026). Cela se manifeste par un mécanisme appelé le « tri panoptique » (« panoptic sort »), théorisé par le chercheur Oscar Grandy (2021), qui permettrait de surveiller en permanence les individus et les communautés, à travers des systèmes de collecte de données commerciales et gouvernementales (Bui, MclIwain, Olojo, Chang, 2026).

Algorithmique prédatrice et reproduction des hiérarchies

Les systèmes de publicité algorithmique seraient alors conçus pour différencier et trier les populations en ligne, et contribueraient à la reproduction des hiérarchies raciales et sociales existantes. L’étude de Grandy démontrerait en effet que les infrastructures publicitaires surveillent les individus pour identifier ceux qui sont les plus susceptibles de succomber à des offres prédatrices, afin d’en optimiser la rentabilité. Ce tri affecte de manière disproportionnée les communautés les plus marginalisées, en particulier les communautés noires de la classe ouvrière. Dans ce contexte, le tri panoptique soutient des processus prédateurs en sélectionnant ces audiences vulnérables pour ensuite les cibler par des produits plus nocifs ou coûteux, comme des prêts sur salaire à frais élevés (Bui, MclIwain, Olojo, Chang, 2026).

Le « reverse redlining » : outil de discrimination numérique

Cela illustre le phénomène du « reverse redlining ». Alors que le redlining historique consistait à exclure systématiquement certains quartiers, souvent racisés, de l’accès aux ressources financières et aux prêts, ce nouveau phénomène fait l’inverse en saturant ces mêmes quartiers d’offres prédatrices (Bui, MclIwain, Olojo, Chang, 2026).

Un exemple marquant est celui de l’Emigrant Mortage Company aux États-Unis. Entre 1999 et 2008, cette banque a utilisé le micro-ciblage et des indices raciaux pour commercialiser de manière agressive des prêts hypothécaires à taux d’intérêt élevés auprès des communautés noires et latinos (Bui, MclIwain, Olojo, Chang, 2026). L’affaire fut surnommée une affaire de « reverse redlining ». En février 2026, la Cour suprême des États-Unis a confirmé une indemnité de 722 000$ contre la compagnie, mettant fin à un litige juridique de près de 15 ans (Wolak, 2026).

Le tri panoptique deviendrait alors un outil d’appauvrissement matériel. En orientant les groupes déjà fragilisés vers des dettes insurmontables ou des services de mauvaise qualité, les algorithmes entretiennent l’appauvrissement historique des communautés marginalisées, tout en générant des profits sur l’exploitation et le renforcement des hiérarchies raciales existantes (Bui, MclIwain, Olojo, Chang, 2026).

Publicité algorithmique et enchères : l’origine économique des biais

La logique des enchères : une source de discrimination numérique

Enfin, la discrimination peut émerger sans intention nocive, par la simple logique des enchères de publicité. Une étude sur Facebook, publiée dans la Marketing Intelligence Review (Lambrecht & Tucker, 2021), a révélé que les publicités pour des carrières en STEM (Sciences, Technologie, Ingénierie et Mathématiques) étaient 20% moins vues par les femmes que par les hommes, bien que l’annonceur n’ait précisé aucun critère de genre dans les paramètres de ciblage automatisé.

Quand l’optimisation économique crée des biais

La raison de ce biais serait en fait purement économique. Selon l’étude, les femmes, qui contrôleraient une part importante du pouvoir d’achat, sont plus « chères » à atteindre sur le marché publicitaire car d’autres secteurs les cibleraient davantage, comme celui du commerce de détail.

Un algorithme publicitaire conçu pour optimiser les coûts finirait donc par favoriser les hommes, simplement parce qu’ils sont moins coûteux à exposer à l’annonce. Cette dynamique favorise alors une discrimination digitale structurelle envers les femmes.

Les paradoxes juridiques face aux biais algorithmiques

Certaines barrières juridiques remettent parfois en cause la tentative de corriger ce genre de biais. Pour les publicités STEM, lancer des campagnes séparées par genre aurait été une solution mentionnée dans l’étude, mais la loi fédérale américaine interdit de cibler des publicités d’emploi selon le genre.

Une loi conçue pour prévenir la discrimination empêche ainsi paradoxalement de corriger des inégalités créés par le marché et les algorithmes publicitaires. L’étude juge insuffisante la simple transparence, comme rendre le code de l’algorithme publique, car elle n’expose pas le contexte économique qui produit ces résultats inéquitables et nourrit les biais structurels (Lambrecht & Tucker, 2021).

Ces biais algorithmiques réitèrent alors le manque d’inclusion historique des femmes dans l’industrie technologique en creusant davantage l’écart de genre préexistant et en entretenant un accès inéquitable aux opportunités.

En résumé…

La discrimination numérique dans la publicité n’est ainsi pas toujours un simple accident technique, mais le résultat d’un mélange entre le contexte social dans lequel les données sont produites et la complexité des outils modernes. Les éléments analysés suggèrent que les algorithmes publicitaires sont loin d’être neutres, et qu’ils peuvent plutôt agir comme amplificateurs du comportement humain. Entrainés sur des données historiques, ils récupèrent en effet les inégalités du passé pour les répéter, et souvent les renforcer, dans l’espace numérique. Ces mécanismes d’optimisation, même s’ils favorisent la performance financière, peinent à prendre en compte les principes de justice et d’équité, que ce soit par l’usage de proxys, par l’instrumentalisation prédatrice du tri panoptique ou par la logique des enchères publicitaires.

L’analyse présentée permet de mieux comprendre certaines causes du problème, mais elle amène toutefois à une autre question importante : comment sortir de ce cercle vicieux ?

La littérature existante semble indiquer que l’avenir du numérique dépendra grandement de notre capacité à assurer une utilisation plus éthique des systèmes algorithmiques et des technologies (Bui, MclIwain, Olojo, Chang, 2026) (Shaheen, 2025).

Sources

Lambrecht, A., & Tucker, C. (2021). « Algorithm-Based Advertising: Unintended Effects and the Tricky Business of Mitigating Adverse Outcomes », NIM Marketing Intelligence Review, 13(1), 24-29. https://doi.org/10.2478/nimmir-2021-0004

Matthew Bui, Charlton McIlwain, Seyi Olojo & Ho-Chun Herbert Chang (2026). « Algorithmic discrimination: a grounded conceptualization », Information, Communication & Society, 29:2, 398-416, https://doi.org/10.1080/1369118X.2025.2516544. Récupéré le 06 mars 2026 de : Full article: Algorithmic discrimination: a grounded conceptualization

Shaheen (2025, 06 novembre). « Ethical Algorithms: How AI Bias Is Changing the Future of Digital Advertising », Medium. Récupéré le 11 mars 2026 de : Ethical Algorithms: How AI Bias Is Changing the Future of Digital Advertising | by Shaheen | Medium

Sweeney, Latanya (2013). « Discrimination in online ad delivery ». Communications of the ACM, 56(5), 44-54. Harvard University Privacy Tools Project. https://doi.org/10.1145/2447976.2447990. Récupéré le 06 mars 2026 de : Discrimination in online ad delivery | Harvard University Privacy Tools Project

Wolak, Sarah (2026, 03 février). « Emigrant Bank’s 15-year dispute against jury award ends at the Supreme Court », HousingWire. Récupéré le 06 mars 2026 de : Emigrant Bank’s predatory lending loss upheld by Supreme Court