L’IA est un outil révolutionnaire qui vient grandement changer l’environnement numérique. Cependant, il ne faut pas tomber dans le piège et l’utiliser de façon non responsable.

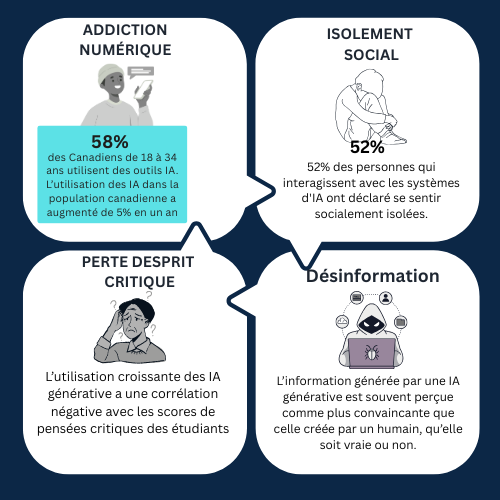

Que ce soit pour l’école, le travail ou même la vie personnelle, l’IA est partout. On peut l’utiliser pour écrire des textes, pour générer des images et des vidéos, pour analyser des données et même pour avoir des conversations. En effet, les outils IA sont utilisés par 58 % des Canadiens de 18 et 34 ans et ce chiffre ne va aller qu’en augmentant. Le graphique suivant démontre les utilisations générales des outils IA au travail et aux études:

Autant l’IA a ses avantages, autant il a ses conséquences… Plus le temps avance, plus les IA sont performants et sophistiqués, plus les gens commencent à les utiliser. C’est ainsi que peut se développer une dépendance à ces outils s’ils sont utilisés de façons démesurées. Cet usage excessif peut avoir des effets sociaux négatifs sur chacune d’entre nous et c’est pour cela que nous trouvons important d’en parler.

Quelles sont ces conséquences sociales?

Dépendance numérique

L’intelligence artificielle occupe désormais une place centrale dans nos vies, et, dans un monde où le numérique est devenu inévitable, de plus en plus de personnes développent une forme de dépendance à ces outils qui nous simplifient le quotidien. Cette dépendance s’installe souvent de manière insidieuse, sans que l’on s’en rende compte. Que ce soit à travers les algorithmes de recommandation sur TikTok ou Instagram, les assistants virtuels qui soutiennent nos tâches scolaires ou professionnelles, ou encore les jeux vidéo enrichis par l’IA, ces technologies sont devenues omniprésentes. L’IA apprend à reconnaître nos habitudes, nos émotions et nos préférences, afin de s’ajuster à nos comportements et capter toujours plus notre attention. Subtilement, elle nous retient devant nos écrans, nous pousse à rester connectés, à cliquer, à consommer. Derrière cette présence constante se cachent des enjeux profonds. C’est pourquoi il est essentiel d’en parler et de vous inviter à reprendre le contrôle.

Isolement social

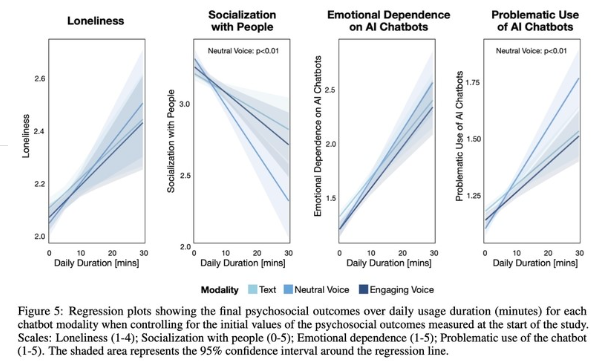

L’isolement social provoqué par l’utilisation excessive de l’IA est une conséquence directe de la dépendance numérique. Selon une étude fait par OpenAI et le MIT, il a été démontré qu’il existe une corrélation négative entre l’utilisation des agents conversationnels et solitude. Les graphiques suivants démontrent cette relation:

Plusieurs facteurs liés à l’IA contribuent à un isolement social de plus en plus présent. D’abord, les agents conversationnels et assistants virtuels remplacent progressivement les services à la clientèle humains, diminuant les échanges authentiques. Ensuite, dans le milieu professionnel, le travail collaboratif tend à disparaître, car l’IA fournit des réponses immédiates, réduisant ainsi les discussions entre collègues. Par ailleurs, nos interactions sociales migrent vers des plateformes numériques, où les contenus et les suggestions de contacts sont souvent pilotés par des algorithmes. Ces interactions, bien que nombreuses, restent superficielles et éloignent peu à peu les relations réelles et profondes qui nourrissent véritablement le lien humain.

Désinformation

Avec l’IA générative, qui devient de plus en plus sophistiquée, il devient de plus en plus difficile de distinguer ce qui est réel et ce qui est généré virtuellement. Les images et les vidéos générées par l’IA sont de plus en plus difficiles à différencier, ce qui crée un réel problème dans le monde numérique, puisqu’il devient de plus en plus facile de créer des campagnes de désinformation. Ceci est aussi vrai pour les agents conversationnels comme ChatGPT, qui n’est toujours pas capable de distinguer les vraies informations des fausses. Ainsi, les réponses proposées par ces agents conversationnels ne sont pas toujours vraies et c’est là le problème. Une étude de l’université de Zurich a démontré que les réponses générées par une IA générative sont souvent perçues comme plus convaincantes que celle créée par un humain, qu’elle soit vraie ou non. C’est pour cela qu’il est très important de valider les informations fournies par l’IA même si l’information semble véridique.

Perte d’esprit critique

L’utilisation excessive de l’IA peut mener à une confiance aveugle envers ces outils. Peu à peu, on risque de tomber dans le piège de la laisser penser à notre place. Plus la confiance envers l’IA augmente, plus la pensée critique tend à diminuer. Et inversement, plus on développe la confiance en soi, plus on est capable de réfléchir par nous-mêmes. Il existe ici un véritable paradoxe : si l’IA peut être bénéfique pour automatiser des tâches simples ou accélérer certaines recherches, elle peut aussi nuire à notre autonomie intellectuelle lorsqu’on l’utilise pour des tâches complexes sans remise en question. Le but n’est pas d’arrêter d’utiliser l’IA, mais plutôt de prendre du recul, de rester vigilant et, surtout, de toujours remettre en question les réponses qu’elle nous donne.

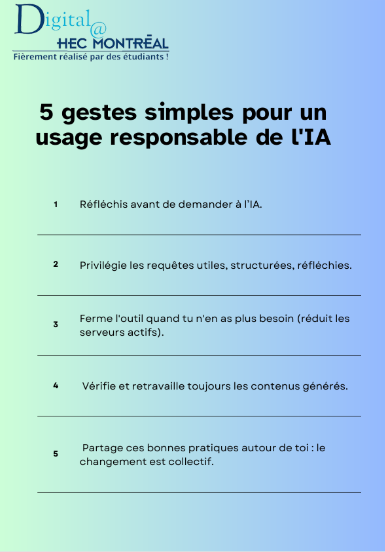

Mais que peut-on faire pour l’utiliser de façon responsable et ne pas tomber dans ces mauvaises habitudes?

Nous sommes venus avec une liste de 5 gestes simples pour utiliser l’IA de façon responsable afin de vous sensibiliser et réduire les chances que vous tombiez dans les mauvaises habitudes que ces outils peuvent entraîner. Les voici:

Sources:

Munn, Y. (2023, 6 septembre). Utilisation des outils d&rsquo ; IA générative par les étudiant⸱es. Collimateur – Veille PéDagonuméRique. https://collimateur.uqam.ca/collimateur/utilisation-des-outils-dia-generative-par-les-etudiant%E2%B8%B1es/

How AI and Human Behaviors Shape Psychosocial Effects of Chatbot Use : A Longitudinal Controlled Study – MIT Media Lab. (s. d.). MIT Media Lab. https://www.media.mit.edu/publications/how-ai-and-human-behaviors-shape-psychosocial-effects-of-chatbot-use-a-longitudinal-controlled-study/

Spitale, G., Biller-Andorno, N., & Germani, F. (2023). AI model GPT-3 (dis)informs us better than humans. Science Advances, 9(26). https://doi.org/10.1126/sciadv.adh1850

To Think or Not to Think : The Impact of AI on Critical-Thinking Skills. (s. d.). NSTA. https://www.nsta.org/blog/think-or-not-think-impact-ai-critical-thinking-skills

Info, R. (2024, 9 février). Le recours à l’IA en hausse dans la population canadienne. Radio-Canada. https://ici.radio-canada.ca/nouvelle/2048276/ia-canada-sondage-hausse-utilisation

Artificial Intelligence : Contribution to Isolation, Loneliness, and Disconnection – GenWell Knowledge Hub. (2024, 23 septembre). GenWell Knowledge Hub. https://hub.genwell.ca/artificial-intelligence-contribution-to-isolation-loneliness-and-disconnection/

Bouhadjeb-Hamdani, M. (2025, 9 février). L’IA jugée plus empathique que les humains. Radio-Canada. https://ici.radio-canada.ca/nouvelle/2136761/ia-empathie-humain-sante-mentale-etude